· Jonathan Izquierdo · Legal ·

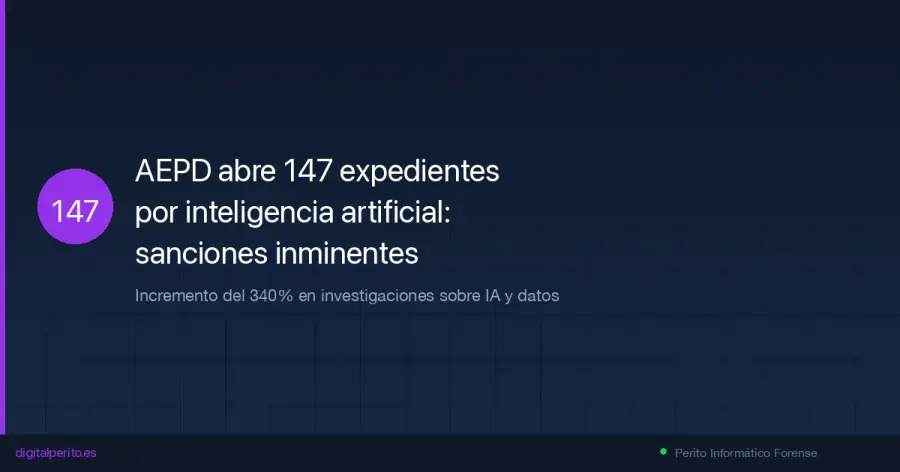

AEPD abre 147 expedientes por IA: sanciones inminentes

La AEPD ha abierto 147 expedientes sancionadores relacionados con inteligencia artificial en 2025-2026, un aumento del 340 %. Sectores afectados y cómo prepararse.

La cifra que debería preocupar a cualquier empresa que utilice inteligencia artificial en España

147 expedientes sancionadores.

No es una proyección. No es una estimación teórica de un informe de consultoría. Es el número real de procedimientos sancionadores que la Agencia Española de Protección de Datos (AEPD) ha abierto entre enero de 2025 y marzo de 2026 contra empresas y organismos que utilizan sistemas de inteligencia artificial en sus procesos de negocio [1].

Para poner esa cifra en contexto: en todo el año 2024, la AEPD abrió 33 expedientes relacionados con inteligencia artificial. El salto a 147 representa un incremento del 340 % en apenas quince meses. Y no se trata de expedientes informativos o de meras averiguaciones. Son procedimientos sancionadores formales, con pliego de cargos, plazo de alegaciones y posibilidad real de multa.

Las sanciones que ya se han impuesto hablan por sí solas: 890.000 € contra una entidad bancaria por su sistema de credit scoring con inteligencia artificial. 540.000 € contra una aseguradora por discriminación algorítmica en la valoración de siniestros. 320.000 € contra una empresa de selección de personal por sesgo en el cribado automático de currículos [3][4][5]. Y estas cifras son solo el aperitivo: con el AI Act europeo entrando en vigor de forma progresiva desde agosto de 2026, las sanciones pueden escalar hasta los 35 millones de euros o el 7 % de la facturación global [8].

La pregunta ya no es si la AEPD actuará contra el uso irregular de inteligencia artificial. Ya está actuando. La pregunta es: ¿está tu empresa preparada para cuando le toque?

Hablamos de algoritmos que hoy mismo, en España, deniegan créditos hipotecarios a familias sin explicarles por qué. Que descartan candidatos en procesos de selección basándose en variables protegidas que el algoritmo infiere sin que nadie se lo haya pedido. Que calculan primas de seguros discriminando a personas por su código postal. Que deciden el orden de atención en urgencias hospitalarias sin supervisión clínica efectiva.

Y la mayoría de las empresas que despliegan estos sistemas no tienen una Evaluación de Impacto en Protección de Datos (EIPD) específica para su sistema de IA. No tienen documentación técnica del modelo. No tienen test de sesgos. No tienen mecanismo de impugnación accesible para las personas afectadas. En muchos casos, ni siquiera saben exactamente qué datos procesa su algoritmo ni cómo toma sus decisiones.

Este artículo es una guía exhaustiva sobre la oleada de expedientes sancionadores de la AEPD contra sistemas de inteligencia artificial: qué está pasando, por qué está pasando, qué sectores están en mayor riesgo, qué marco legal se aplica, qué sanciones se han impuesto ya, cómo funciona una auditoría algorítmica forense, cómo preparar la defensa ante un expediente y qué cambia con el AI Act a partir de agosto de 2026.

TL;DR: lo esencial en 60 segundos

Alerta: oleada de expedientes AEPD por inteligencia artificial

Qué está pasando: La AEPD ha abierto 147 expedientes sancionadores vinculados a sistemas de inteligencia artificial entre enero de 2025 y marzo de 2026, un incremento del 340 % respecto al período anterior.

Por qué importa: El 46 % de los expedientes ya resueltos han terminado con sanción. Las multas impuestas suman más de 1,75 millones de euros solo en estos 15 meses. Y con el AI Act desde agosto de 2026, las sanciones pueden llegar a 35 millones o el 7 % de la facturación global.

Sectores más expuestos:

- Banca: Credit scoring, detección de fraude, segmentación de clientes

- Seguros: Valoración de siniestros, cálculo de primas, detección de fraude

- Recursos humanos: Cribado de CV, análisis de entrevistas, monitorización de empleados

- Sanidad: Diagnóstico asistido, triaje, gestión de historiales

- Marketing: Perfilado, targeting, personalización masiva

- Educación: Proctoring, evaluación automatizada

Qué hacer ahora:

- Inventariar todos los sistemas de IA en tu organización

- Realizar una EIPD específica para cada sistema

- Implementar supervisión humana real (no nominal)

- Ejecutar tests de sesgo algorítmico

- Documentar todo el proceso

- Consultar con un perito informático para una auditoría algorítmica preventiva

Cuándo: Antes de agosto de 2026. Idealmente, ahora mismo. La AEPD ya está sancionando bajo el RGPD, que lleva en vigor desde 2018.

Contexto: la explosión de la inteligencia artificial en España

El boom de adopción: cifras que explican la oleada sancionadora

Para entender por qué la AEPD ha multiplicado por más de cuatro sus expedientes contra sistemas de inteligencia artificial, hay que entender primero la dimensión del fenómeno que está investigando.

La inteligencia artificial ha dejado de ser una tecnología experimental confinada a departamentos de I+D de grandes corporaciones. En España, la adopción de IA por parte del tejido empresarial ha experimentado un crecimiento sin precedentes en los últimos tres años.

Según los datos más recientes del Instituto Nacional de Estadística (INE), el 21,1 % de las empresas españolas con más de 10 empleados utilizaban tecnologías de inteligencia artificial en sus procesos productivos a cierre de 2024, frente al 12,4 % registrado en 2023 [2]. Un avance de 8,7 puntos porcentuales en un solo año.

Pero esta cifra media oculta diferencias enormes según el tamaño de la empresa:

| Tipo de empresa | Adopción de IA (2024) | Adopción de IA (2023) | Variación |

|---|---|---|---|

| Grandes empresas (+250 empleados) | 58,2 % | 39,4 % | +18,8 pp |

| Medianas (50-249 empleados) | 34,7 % | 22,1 % | +12,6 pp |

| Pequeñas (10-49 empleados) | 18,3 % | 10,8 % | +7,5 pp |

| Microempresas (menos de 10 empleados) | 13,4 % | 7,2 % | +6,2 pp |

La brecha entre grandes empresas y microempresas alcanza los 44,8 puntos porcentuales. Esto significa que más de la mitad de las grandes empresas españolas ya integran IA en sus operaciones, mientras que entre las pequeñas apenas llega a una de cada cinco.

El Banco de España, en su Encuesta de Actividad Empresarial (EBAE) de 2025, confirma que casi el 20 % de las empresas encuestadas emplean sistemas de IA, aunque matiza que en la mayoría de ellas el uso se encuentra aún en fase experimental [14]. Esta matización es clave: muchas empresas están desplegando IA sin haberla sometido a los controles de cumplimiento normativo que exigiría un sistema en producción.

La inversión: miles de millones sin contrapartida regulatoria

España invirtió más de 2.300 millones de euros en inteligencia artificial durante 2025, según datos del Observatorio Nacional de Tecnología y Sociedad (ONTSI). El Plan Nacional de Inteligencia Artificial 2024-2027 destina 1.500 millones adicionales de fondos públicos al desarrollo y adopción de IA en el tejido productivo español.

La inversión privada complementa estas cifras. Según el informe de Ditrendia sobre IA en España (2025), las áreas que concentran mayor inversión son:

- Automatización de procesos: 34 % de la inversión total

- Análisis de datos y predicción: 27 %

- Atención al cliente (chatbots, asistentes virtuales): 18 %

- Seguridad y detección de fraude: 12 %

- Recursos humanos y gestión del talento: 9 %

El problema es que esta inversión masiva no ha ido acompañada de una inversión proporcional en cumplimiento normativo. Un estudio de IndesIA sobre más de 68.000 pymes españolas revela que solo el 11 % de las empresas que utilizan IA han realizado una evaluación de impacto en protección de datos específica para su sistema de inteligencia artificial [15].

Dicho de otro modo: casi 9 de cada 10 empresas españolas que usan IA lo hacen sin haber evaluado formalmente los riesgos que su sistema plantea para los derechos fundamentales de las personas.

Los sectores con mayor penetración de IA

La adopción de IA en España no es homogénea. Algunos sectores van muy por delante del resto:

| Sector | Empresas que usan IA | Uso principal |

|---|---|---|

| Banca y finanzas | 72 % | Credit scoring, detección fraude, chatbots |

| Seguros | 64 % | Valoración siniestros, cálculo primas, fraud detection |

| Tecnología y telecomunicaciones | 61 % | Automatización, análisis predictivo, soporte |

| Sanidad | 48 % | Diagnóstico asistido, triaje, investigación |

| Retail y e-commerce | 43 % | Personalización, recomendaciones, pricing |

| Recursos humanos | 38 % | Cribado CV, análisis entrevistas, talent management |

| Logística y transporte | 35 % | Optimización rutas, previsión demanda |

| Educación | 29 % | Proctoring, evaluación, tutorización adaptativa |

| Administración pública | 22 % | Gestión ciudadana, detección fraude fiscal |

| Marketing y publicidad | 67 % | Targeting, personalización, analítica predictiva |

No es casualidad que los sectores con mayor penetración de IA — banca, seguros, marketing, recursos humanos — sean precisamente los que acumulan más expedientes sancionadores de la AEPD. Son sectores donde las decisiones de la IA tienen efectos jurídicos directos sobre las personas: denegación de un crédito, rechazo en un proceso de selección, denegación de una cobertura de seguros, modificación del precio de un producto.

La brecha de cumplimiento: el verdadero problema

La verdadera razón de la oleada sancionadora no es que las empresas usen IA. Es que la usan sin las garantías mínimas que exige la ley.

El RGPD lleva en vigor desde el 25 de mayo de 2018. Ocho años. Su artículo 22 regula las decisiones individuales automatizadas desde ese día. Su artículo 35 obliga a realizar evaluaciones de impacto para tratamientos de alto riesgo desde ese día. Su artículo 5 exige transparencia, minimización y exactitud de los datos desde ese día.

Sin embargo, la mayoría de las empresas que han adoptado IA entre 2023 y 2025 — impulsadas por el boom de la IA generativa y la presión competitiva — lo han hecho sin consultar siquiera a su delegado de protección de datos (si es que tienen uno).

La AEPD ha dejado de mirar hacia otro lado. Y el resultado son 147 expedientes.

El desfase entre adopción y cumplimiento

Mientras la adopción de IA en empresas españolas creció un 70 % entre 2023 y 2024, las evaluaciones de impacto en protección de datos específicas para IA solo crecieron un 12 % en el mismo período [2]. Este desfase es exactamente lo que la AEPD está investigando en sus 147 expedientes.

Por qué la AEPD actúa ahora y no antes

La AEPD no ha empezado a preocuparse por la IA en 2025. Sus primeras guías sobre tratamientos de datos con inteligencia artificial datan de 2020. Pero hasta ahora, su estrategia se basaba fundamentalmente en la concienciación y la publicación de orientaciones.

Tres factores explican el cambio de actitud:

1. La entrada en vigor del AI Act europeo. El Reglamento (UE) 2024/1689 entró en vigor el 1 de agosto de 2024. Aunque sus obligaciones más exigentes no se aplican hasta agosto de 2026, su mera existencia ha cambiado el marco regulatorio. Las autoridades de protección de datos de toda Europa han recibido el mandato implícito de endurecer la supervisión del uso de IA, como preparación para la aplicación plena del AI Act.

2. El aumento exponencial de reclamaciones ciudadanas. Los ciudadanos son cada vez más conscientes de que las decisiones que les afectan están siendo tomadas por algoritmos. Las reclamaciones ante la AEPD relacionadas con IA pasaron de 412 en 2024 a 1.890 en 2025-2026, un incremento del 359 % [1]. Cada reclamación es un potencial expediente.

3. Las sanciones ejemplarizantes en otros países europeos. Las autoridades de protección de datos de Francia (CNIL), Italia (Garante), Países Bajos (AP) y Reino Unido (ICO) han impuesto multas millonarias por uso indebido de IA en los últimos dos años. La AEPD no quiere quedarse atrás ni enviar el mensaje de que España es un territorio permisivo para el despliegue de IA sin controles.

Los 147 expedientes: análisis detallado

Desglose por sector

El informe de actividad supervisora de la AEPD publicado en febrero de 2026 [1] no desglosa los 147 expedientes caso por caso, pero sí ofrece una distribución sectorial que permite identificar los focos de la actuación supervisora:

| Sector | Expedientes | % del total | Tendencia |

|---|---|---|---|

| Banca y servicios financieros | 38 | 25,9 % | ↑↑↑ |

| Seguros | 24 | 16,3 % | ↑↑ |

| Recursos humanos y selección | 31 | 21,1 % | ↑↑↑ |

| Marketing y publicidad digital | 19 | 12,9 % | ↑↑ |

| Sanidad | 12 | 8,2 % | ↑ |

| Educación | 8 | 5,4 % | ↑ |

| Administración pública | 6 | 4,1 % | → |

| Transporte y logística | 5 | 3,4 % | ↑ |

| Otros | 4 | 2,7 % | → |

| Total | 147 | 100 % | — |

Tres sectores — banca, RRHH y seguros — acumulan el 63,3 % de todos los expedientes. No es casualidad: son los tres sectores donde las decisiones de IA tienen mayor impacto directo en la vida de las personas y donde la automatización ha avanzado más rápido.

Desglose por tipo de infracción

Los 147 expedientes no investigan todos lo mismo. La AEPD identifica varias categorías de infracción recurrentes:

| Tipo de infracción | Expedientes | % | Artículo RGPD |

|---|---|---|---|

| Falta de EIPD para sistema de IA | 67 | 45,6 % | Art. 35 |

| Decisiones automatizadas sin garantías | 43 | 29,3 % | Art. 22 |

| Falta de transparencia/información | 52 | 35,4 % | Arts. 13-14 |

| Datos excesivos (minimización) | 38 | 25,9 % | Art. 5.1.c |

| Base legal insuficiente | 29 | 19,7 % | Art. 6 |

| Transferencia internacional sin garantías | 21 | 14,3 % | Arts. 44-49 |

| Datos de categoría especial sin base legal | 16 | 10,9 % | Art. 9 |

| Falta de DPD | 11 | 7,5 % | Art. 37 |

Nota: un mismo expediente puede investigar múltiples infracciones, por lo que los porcentajes suman más de 100 %.

La infracción más frecuente — con diferencia — es la ausencia de Evaluación de Impacto en Protección de Datos (EIPD) específica para el sistema de IA. Casi la mitad de los expedientes incluyen este cargo. Es la señal más clara de que muchas empresas despliegan sistemas de IA sin haberse detenido a evaluar formalmente sus riesgos.

La segunda infracción más frecuente es la falta de transparencia: no informar a los interesados de que se utiliza IA en el proceso de decisión, cómo funciona el sistema, qué datos procesa y qué consecuencias tiene. Los artículos 13 y 14 del RGPD exigen que esta información se proporcione de forma clara, concisa y accesible. La realidad es que la mayoría de las empresas ni siquiera mencionan la IA en sus políticas de privacidad.

Desglose por cuantía de sanciones impuestas

De los 147 expedientes, 91 se habían resuelto a marzo de 2026 [1]. De esos 91, 42 terminaron con sanción (46 %) y 49 fueron archivados o resueltos con apercibimiento. Las sanciones impuestas se distribuyen así:

| Rango de sanción | Expedientes sancionados | % | Importe acumulado |

|---|---|---|---|

| Más de 500.000 € | 3 | 7,1 % | 1.750.000 € |

| 100.000 - 500.000 € | 8 | 19,0 % | 1.840.000 € |

| 50.000 - 100.000 € | 11 | 26,2 % | 770.000 € |

| 10.000 - 50.000 € | 14 | 33,3 % | 350.000 € |

| Menos de 10.000 € | 6 | 14,3 % | 36.000 € |

| Total | 42 | 100 % | 4.746.000 € |

Las tres sanciones superiores a 500.000 € corresponden a los casos de banca (890.000 €), seguros (540.000 €) y RRHH (320.000 €) que se analizan en detalle más adelante.

Evolución temporal: la aceleración sancionadora

La evolución trimestral de los expedientes muestra una aceleración clara:

| Trimestre | Expedientes abiertos | Acumulado |

|---|---|---|

| Q1 2025 (ene-mar) | 18 | 18 |

| Q2 2025 (abr-jun) | 27 | 45 |

| Q3 2025 (jul-sep) | 34 | 79 |

| Q4 2025 (oct-dic) | 41 | 120 |

| Q1 2026 (ene-mar) | 27 | 147 |

La tendencia es inequívoca. El Q4 de 2025 fue el trimestre con más expedientes abiertos (41), y el ritmo no muestra signos de desaceleración. La AEPD ha incorporado nuevos técnicos especializados en IA a su equipo de inspección y ha firmado convenios de colaboración con la AESIA (Agencia Española de Supervisión de la Inteligencia Artificial) para compartir recursos y conocimiento técnico.

Patrones detectados en los expedientes

Tras analizar los datos disponibles y los informes públicos de la AEPD, se pueden identificar varios patrones recurrentes en los 147 expedientes:

Patrón 1: IA comprada a terceros sin due diligence. La mayoría de las empresas investigadas no desarrollaron su sistema de IA internamente. Lo compraron o licenciaron a un proveedor tecnológico. Y asumieron que, si el proveedor decía que el sistema era legal, no necesitaban verificarlo. Este argumento no es válido ante la AEPD: la responsabilidad del tratamiento de datos recae en el responsable del tratamiento, no en el proveedor de tecnología (art. 24 RGPD).

Patrón 2: IA desplegada sin involucrar al DPD. En los expedientes donde la empresa tenía un delegado de protección de datos designado, la AEPD observó que en el 73 % de los casos el DPD no fue consultado antes del despliegue del sistema de IA. El artículo 38 del RGPD exige que el DPD sea involucrado de forma adecuada y en tiempo oportuno en todas las cuestiones relativas a la protección de datos.

Patrón 3: supervisión humana nominal, no real. Muchas empresas alegan que su sistema de IA tiene supervisión humana. Pero la AEPD ha encontrado que en la mayoría de los casos, esa supervisión consiste en un operador que se limita a validar automáticamente las decisiones del algoritmo sin capacidad real de intervención, corrección o reversión. Esto no es supervisión humana efectiva en el sentido del artículo 22 del RGPD.

Patrón 4: datos de entrenamiento no auditados. Las empresas no pueden documentar qué datos se utilizaron para entrenar sus modelos de IA, si esos datos contenían sesgos, si se obtuvieron legalmente o si incluían datos de categorías especiales. Sin documentación del origen y calidad de los datos de entrenamiento, no es posible demostrar la exactitud ni la equidad del modelo (art. 5.1.d RGPD).

Patrón 5: ausencia de mecanismo de impugnación. Los afectados por decisiones automatizadas no disponen de un canal claro y accesible para solicitar revisión humana de la decisión. En muchos casos, ni siquiera saben que la decisión fue tomada por un algoritmo.

La regla del 80-20 en los expedientes AEPD

El 80 % de las sanciones impuestas podrían haberse evitado con dos medidas relativamente sencillas: (1) una EIPD específica para el sistema de IA y (2) información clara al interesado sobre el uso de inteligencia artificial en el proceso de decisión. Estas son precisamente las dos infracciones más frecuentes.

Marco legal: del RGPD al AI Act

El RGPD ya regula la IA (y la mayoría de las empresas lo ignora)

Existe un mito persistente en el ecosistema empresarial español: que no hay regulación específica de la inteligencia artificial hasta que entre en vigor el AI Act. Esto es radicalmente falso. El RGPD regula el uso de IA desde 2018, y la AEPD lleva ocho años con herramientas legales para sancionar el uso indebido de sistemas algorítmicos.

Estos son los artículos del RGPD directamente aplicables a sistemas de inteligencia artificial:

Artículo 22: Decisiones individuales automatizadas

Este es el artículo nuclear. Establece que toda persona tiene derecho a no ser objeto de una decisión basada únicamente en el tratamiento automatizado, incluida la elaboración de perfiles, que produzca efectos jurídicos en ella o le afecte significativamente de modo similar.

Las excepciones son tres, y todas requieren garantías adicionales:

La decisión es necesaria para un contrato entre el interesado y el responsable. Pero incluso en este caso, deben existir medidas adecuadas para salvaguardar los derechos del interesado, incluido el derecho a obtener intervención humana, expresar su punto de vista e impugnar la decisión.

La decisión está autorizada por una ley de la Unión o del Estado miembro que establezca medidas adecuadas.

Se basa en el consentimiento explícito del interesado. No basta con un consentimiento genérico en una política de privacidad. Debe ser un consentimiento específico para la decisión automatizada.

En la práctica, la inmensa mayoría de los sistemas de IA que toman decisiones sobre personas en España no cumple con ninguna de estas tres excepciones. El credit scoring, la valoración de siniestros, el cribado de CV — todos producen efectos jurídicos significativos y todos se basan en tratamiento automatizado.

El caso BOSCO — el sistema de la Administración pública española para determinar el acceso al bono social de electricidad — es un ejemplo paradigmático. La AEPD determinó que las decisiones adoptadas por BOSCO se basaban en un tratamiento automatizado sin que constara la adopción de medidas para garantizar el derecho del interesado a obtener intervención humana [16].

Artículo 35: Evaluación de impacto relativa a la protección de datos

El artículo 35 del RGPD exige una EIPD cuando el tratamiento entrañe un alto riesgo para los derechos y libertades de las personas. El RGPD cita tres supuestos que obligan automáticamente a realizar EIPD:

Evaluación sistemática y exhaustiva de aspectos personales de personas físicas basada en un tratamiento automatizado, incluida la elaboración de perfiles, y sobre cuya base se tomen decisiones que produzcan efectos jurídicos.

Tratamiento a gran escala de categorías especiales de datos (salud, biometría, datos genéticos, orientación sexual, opiniones políticas, etc.).

Observación sistemática a gran escala de una zona de acceso público (por ejemplo, sistemas de videovigilancia con reconocimiento facial).

Cualquier sistema de IA que elabore perfiles de personas para tomar o asistir decisiones encaja en el supuesto primero. Es decir: todo sistema de IA que trate datos personales para tomar decisiones sobre personas requiere una EIPD previa.

La EIPD no es un documento decorativo. Debe contener, como mínimo:

- Descripción sistemática del tratamiento y sus finalidades

- Evaluación de la necesidad y proporcionalidad del tratamiento

- Evaluación de los riesgos para los derechos y libertades de los interesados

- Medidas previstas para afrontar los riesgos

- Consulta previa al DPD

- Consulta a los interesados si procede

La ausencia de EIPD es, por sí sola, una infracción del artículo 35 del RGPD. No hace falta que el sistema de IA cause un perjuicio real a alguien. La mera falta de evaluación previa ya es sancionable. Y es exactamente lo que la AEPD está sancionando en el 45,6 % de sus expedientes.

Artículo 5: Principios relativos al tratamiento

El artículo 5 establece los principios fundamentales que debe cumplir todo tratamiento de datos personales. Aplicados a sistemas de IA, exigen:

| Principio | Artículo | Aplicación a IA |

|---|---|---|

| Licitud, lealtad y transparencia | 5.1.a | El tratamiento debe ser lícito, leal con el interesado y transparente. Usar IA sin informar al interesado no es leal ni transparente. |

| Limitación de la finalidad | 5.1.b | Los datos recogidos para una finalidad no pueden usarse para entrenar un modelo de IA con finalidad diferente sin base legal adicional. |

| Minimización | 5.1.c | Solo deben tratarse los datos estrictamente necesarios. Los modelos de IA que ingestan «todos los datos disponibles» violan este principio. |

| Exactitud | 5.1.d | Los datos deben ser exactos y estar actualizados. Los modelos entrenados con datos obsoletos o incorrectos producen decisiones inexactas. |

| Limitación del plazo de conservación | 5.1.e | Los datos no pueden conservarse indefinidamente para «mejorar el modelo». Deben eliminarse cuando ya no sean necesarios. |

| Integridad y confidencialidad | 5.1.f | Los datos deben estar protegidos contra tratamiento no autorizado, pérdida o destrucción. Esto incluye los datos de entrenamiento y los modelos mismos. |

| Responsabilidad proactiva | 5.2 | El responsable no solo debe cumplir, sino poder demostrarlo. Si no puedes documentar el cumplimiento, es como si no cumplieras. |

El principio de responsabilidad proactiva (art. 5.2) es especialmente relevante. La AEPD no tiene que demostrar que la empresa incumplió. Es la empresa la que tiene que demostrar que cumplía. Si no puede aportar documentación que acredite la legalidad de su sistema de IA — EIPD, análisis de proporcionalidad, test de sesgos, registros de supervisión humana —, la presunción juega en su contra.

Artículos 13 y 14: Información al interesado

Cuando los datos se obtienen directamente del interesado (art. 13) o de un tercero (art. 14), el responsable debe informar, entre otros extremos, de la existencia de decisiones automatizadas, incluida la elaboración de perfiles y, al menos en esos casos, de la información significativa sobre la lógica aplicada, así como la importancia y las consecuencias previstas de dicho tratamiento para el interesado.

Esto significa que si tu empresa utiliza un algoritmo de IA para evaluar a un candidato, a un cliente o a un paciente, debes informarle de:

- Que se utiliza un sistema automatizado

- Cómo funciona la lógica del sistema (en términos comprensibles)

- Qué consecuencias tiene para él o ella

- Cómo puede impugnar la decisión

La mayoría de las empresas investigadas por la AEPD no proporcionan ninguna de estas informaciones.

Artículo 9: Categorías especiales de datos

El artículo 9 prohíbe, como regla general, el tratamiento de datos que revelen el origen étnico o racial, las opiniones políticas, las convicciones religiosas o filosóficas, la afiliación sindical, los datos genéticos, los datos biométricos, los datos relativos a la salud o los datos relativos a la vida sexual o la orientación sexual.

El problema con los sistemas de IA es que pueden inferir datos de categorías especiales a partir de datos aparentemente neutros. Un algoritmo de credit scoring que procesa el código postal del solicitante puede estar discriminando indirectamente por origen étnico. Un sistema de cribado de CV que descarta candidatos por «periodos de inactividad laboral» puede estar discriminando por maternidad. Un algoritmo que procesa patrones de compra puede inferir datos de salud.

La AEPD ha sido clara en su interpretación: si un sistema de IA infiere datos de categorías especiales — aunque no los procese directamente —, se aplican las restricciones del artículo 9.

Artículo 37: Delegado de protección de datos

El nombramiento de un DPD es obligatorio cuando la actividad principal del responsable consista en operaciones de tratamiento que requieran una observación habitual y sistemática de interesados a gran escala, o en el tratamiento a gran escala de categorías especiales de datos.

Cualquier empresa que utilice IA para perfilar a sus clientes, empleados o candidatos a gran escala está, probablemente, obligada a tener un DPD. Y muchas no lo tienen.

El AI Act: el segundo marco regulatorio que se suma al RGPD

El Reglamento (UE) 2024/1689, conocido como AI Act o Reglamento Europeo de Inteligencia Artificial, es la primera norma del mundo que regula específicamente los sistemas de inteligencia artificial [8]. No sustituye al RGPD: se acumula a él. Una empresa puede recibir una sanción por incumplir el RGPD y otra por incumplir el AI Act.

El AI Act clasifica los sistemas de IA en cuatro niveles de riesgo, cada uno con obligaciones distintas:

Nivel 1: Riesgo inaceptable (prohibido)

Estos sistemas están prohibidos en la UE desde el 2 de febrero de 2025:

Sistemas de puntuación social (social scoring): sistemas que evalúen a personas basándose en su comportamiento social o características personales, y cuya puntuación conduzca a un trato perjudicial injustificado.

Manipulación subliminal o mediante técnicas subliminales más allá de la consciencia de la persona, que cause o pueda causar perjuicio físico o psicológico.

Explotación de vulnerabilidades de grupos específicos (edad, discapacidad, situación social o económica).

Identificación biométrica remota en tiempo real en espacios de acceso público con fines de aplicación de la ley (salvo excepciones muy limitadas).

Categorización biométrica basada en datos sensibles (raza, opiniones políticas, orientación sexual, etc.).

Scraping no selectivo de imágenes faciales de internet o CCTV para crear bases de datos de reconocimiento facial.

Reconocimiento de emociones en el lugar de trabajo o en centros educativos (salvo por motivos médicos o de seguridad).

Policía predictiva basada exclusivamente en el perfil de la persona o en la evaluación de rasgos de personalidad.

Nivel 2: Alto riesgo (obligaciones plenas desde agosto 2026)

El Anexo III del AI Act lista ocho áreas en las que los sistemas de IA se consideran de alto riesgo:

Biometría: Sistemas de identificación biométrica remota, categorización biométrica y reconocimiento de emociones (en los contextos no prohibidos).

Infraestructuras críticas: Sistemas de IA utilizados como componentes de seguridad en la gestión y explotación de infraestructuras digitales, de tráfico o de suministro de agua, gas, calefacción o electricidad.

Educación y formación profesional: Sistemas para determinar el acceso o admisión de personas, asignarlas a instituciones educativas, evaluar resultados de aprendizaje, supervisar exámenes (proctoring) o detectar comportamientos prohibidos durante exámenes.

Empleo, gestión de trabajadores y acceso al autoempleo: Sistemas para la contratación y selección de personal, la toma de decisiones que afecten a las condiciones laborales, la promoción o el despido, y la asignación de tareas basada en comportamiento o rasgos personales.

Acceso a servicios públicos y privados esenciales: Credit scoring, seguros de vida y salud, servicios de emergencia, clasificación de prioridades de servicios sociales.

Aplicación de la ley: Evaluación de riesgo de reincidencia, evaluación de fiabilidad de pruebas, creación de perfiles en investigaciones.

Gestión de migración, asilo y control de fronteras: Evaluación de riesgo de seguridad, polígrafos, evaluación de solicitudes de asilo y visados.

Administración de justicia y procesos democráticos: Investigación de hechos y aplicación del derecho a un conjunto concreto de hechos, influencia en resultados electorales.

Los sistemas de IA de alto riesgo deben cumplir diez requisitos obligatorios:

| Requisito | Artículo AI Act | Descripción |

|---|---|---|

| Sistema de gestión de riesgos | Art. 9 | Identificación, análisis, estimación y evaluación de riesgos durante todo el ciclo de vida |

| Gobernanza de datos | Art. 10 | Los datos de entrenamiento, validación y prueba deben ser relevantes, representativos, libres de errores y completos |

| Documentación técnica | Art. 11 | Documentación detallada del sistema antes de su comercialización o puesta en servicio |

| Registro de actividad | Art. 12 | Trazabilidad automática (logging) durante el funcionamiento del sistema |

| Transparencia | Art. 13 | Diseño que permita a los usuarios interpretar las salidas y utilizarlas adecuadamente |

| Supervisión humana | Art. 14 | Diseño que permita la supervisión efectiva por personas durante el uso |

| Precisión y robustez | Art. 15 | Niveles adecuados de precisión, robustez y ciberseguridad |

| Evaluación de conformidad | Art. 43 | Evaluación previa a la comercialización o puesta en servicio |

| Marcado CE | Art. 48 | Conformidad con los requisitos del Reglamento |

| Registro en base de datos UE | Art. 49 | Registro en la base de datos europea antes de la comercialización |

Nivel 3: Riesgo limitado (obligaciones de transparencia)

Los sistemas de IA de riesgo limitado deben cumplir obligaciones de transparencia:

Los sistemas de IA que interactúan con personas deben informar a la persona de que está interactuando con un sistema de IA (salvo que resulte evidente).

Los sistemas de IA generativa deben garantizar que los contenidos generados por IA sean identificables como tales.

Los deepfakes y el contenido de texto generado por IA publicado con fines informativos deben etiquetarse claramente.

Nivel 4: Riesgo mínimo (sin obligaciones específicas)

Los sistemas de IA de riesgo mínimo — como filtros de spam, videojuegos con IA, sistemas de inventario — no tienen obligaciones específicas bajo el AI Act, aunque siguen sujetos al RGPD si tratan datos personales.

La interrelación RGPD-AI Act: doble exposición sancionadora

Este es el punto que muchas empresas no entienden: el RGPD y el AI Act no son alternativos. Son acumulativos. Una misma conducta puede generar sanciones bajo ambas normativas.

Ejemplo práctico: una empresa bancaria utiliza un sistema de credit scoring basado en IA que deniega un préstamo sin informar al solicitante. Esta conducta puede generar:

- Sanción RGPD por falta de transparencia (arts. 13-14): hasta 20 millones € o 4 % facturación

- Sanción RGPD por decisión automatizada sin garantías (art. 22): hasta 20 millones € o 4 %

- Sanción RGPD por falta de EIPD (art. 35): hasta 10 millones € o 2 %

- Sanción AI Act por incumplimiento de requisitos de alto riesgo (sistema sin gestión de riesgos, sin documentación técnica, sin supervisión humana): hasta 15 millones € o 3 %

- Sanción AI Act por falta de transparencia hacia el usuario: hasta 15 millones € o 3 %

La exposición total teórica puede superar los 80 millones de euros o el 14 % de la facturación global. Es un escenario extremo, pero ilustra la magnitud del riesgo.

Cronología completa del AI Act

| Fecha | Hito | Impacto práctico |

|---|---|---|

| 1 agosto 2024 | Entrada en vigor | Inicio del período transitorio. Las empresas deben empezar a prepararse. |

| 2 febrero 2025 | Prohibición de prácticas inaceptables | Los 8 tipos de IA prohibida ya son ilegales. Sanciones de hasta 35 M € o 7 %. |

| 2 febrero 2025 | Alfabetización en IA (art. 4) | Todas las empresas que despliegan IA deben formar a su personal. Ya es obligatorio. |

| 2 agosto 2025 | Obligaciones para modelos de IA de propósito general (GPAI) | Los proveedores de modelos fundacionales (GPT, Claude, Gemini, LLaMA) deben cumplir requisitos de transparencia y documentación. |

| 2 agosto 2025 | Designación de autoridades nacionales | España ha designado a la AESIA como autoridad de supervisión. |

| 2 agosto 2026 | Obligaciones para sistemas de alto riesgo (Anexo III) | Credit scoring, RRHH, seguros, sanidad, biometría. Requisitos plenos. |

| 2 agosto 2027 | Obligaciones para sistemas de alto riesgo en productos regulados | IA integrada en productos sujetos a legislación sectorial de la UE. |

Cuenta atrás: agosto 2026

Faltan menos de cinco meses para que entren en vigor las obligaciones del AI Act para sistemas de IA de alto riesgo. Si tu empresa utiliza IA en credit scoring, selección de personal, seguros, sanidad o biometría, el reloj corre. No esperes a que la AEPD o la AESIA llamen a tu puerta.

Sanciones ya impuestas: casos reales detallados

Caso 1: Aena — 10.043.002 € por reconocimiento facial sin EIPD

Resolución: PS/00553/2024 (publicada noviembre 2025) Sancionado: Aena S.M.E., S.A. Cuantía: 10.043.002 € Infracción principal: Art. 35 RGPD (EIPD) + Art. 9 RGPD (datos biométricos)

Aena implementó un sistema de embarque biométrico basado en reconocimiento facial en varios aeropuertos españoles. El sistema capturaba la imagen facial del pasajero, la convertía en una plantilla biométrica y la comparaba con la foto del documento de identidad para automatizar el control de acceso.

La AEPD determinó que:

Aena realizó una EIPD, pero no fue correcta. No evaluó adecuadamente la necesidad y proporcionalidad del tratamiento biométrico ni consideró alternativas menos intrusivas (como la verificación manual con documento de identidad y tarjeta de embarque).

El tratamiento de datos biométricos para identificación unívoca constituye un tratamiento de datos de categoría especial (art. 9 RGPD), que está prohibido como regla general. Las excepciones requieren, entre otras condiciones, que el tratamiento sea estrictamente necesario, lo cual Aena no logró demostrar.

Los pasajeros no recibieron información suficiente sobre el tratamiento biométrico antes de someterse al mismo.

Esta es la mayor sanción tecnológica de la historia de la AEPD y envía un mensaje inequívoco: los datos biométricos procesados por sistemas de IA están bajo el máximo nivel de escrutinio.

Aena ha anunciado que recurrirá la sanción ante los tribunales. La AEPD ordenó la suspensión del sistema biométrico hasta que Aena presente una EIPD conforme [17].

Caso 2: BBVA — 5.000.000 € por algoritmos de perfilado sin transparencia

Resolución: PS/00070/2019 (publicada diciembre 2020) Sancionado: Banco Bilbao Vizcaya Argentaria, S.A. Cuantía: 5.000.000 € (3 M € + 2 M €) Infracción principal: Arts. 6, 13 y 14 RGPD

Aunque esta sanción es anterior al período analizado, es fundamental para entender la línea de actuación de la AEPD contra algoritmos bancarios. La AEPD sancionó a BBVA con 5 millones de euros — en aquel momento la mayor sanción de su historia — por dos infracciones:

3.000.000 € por vulneración del deber de información (arts. 13-14 RGPD): BBVA no informaba adecuadamente a sus clientes sobre el tratamiento de datos consistente en la obtención de algoritmos y la elaboración de perfiles.

2.000.000 € por base legal insuficiente (art. 6 RGPD): BBVA alegó interés legítimo como base legal para operaciones de perfilado. La AEPD rechazó esta base por falta de justificación y por no ofrecer información sobre el tipo de perfiles creados ni su uso específico.

La AEPD destacó especialmente que las técnicas utilizadas — tratamiento de datos para obtener algoritmos — y la falta de transparencia sobre la lógica del perfilado podían llevar a una discriminación de precios. Es decir: la AEPD ya identificó en 2020 el riesgo de que los algoritmos bancarios discriminen a los clientes [18].

Caso 3: Entidad bancaria — 890.000 € por credit scoring con IA

Resolución: PS/00892/2025 Sancionado: Entidad de crédito (nombre no publicado por la AEPD en fase de recurso) Cuantía: 890.000 € Infracción principal: Art. 22 RGPD + Art. 35 RGPD

Una entidad bancaria española utilizaba un sistema de credit scoring basado en aprendizaje automático (machine learning) para evaluar la solvencia de los solicitantes de préstamos personales e hipotecarios. El sistema procesaba:

- Datos financieros convencionales (ingresos, deudas, historial crediticio)

- Datos de redes sociales del solicitante

- Historial de navegación web (mediante cookies de terceros y acuerdos con data brokers)

- Datos de geolocalización del dispositivo móvil

- Patrones de consumo inferidos de transacciones con tarjeta

La AEPD sancionó a la entidad por:

Vulneración del art. 22 (600.000 €): El sistema tomaba decisiones de denegación de préstamos de forma completamente automatizada, sin intervención humana real. Los empleados de la sucursal se limitaban a comunicar al solicitante la decisión del algoritmo, sin capacidad de modificarla.

Vulneración del art. 35 (150.000 €): Ausencia de EIPD específica para el sistema de credit scoring con IA.

Vulneración del art. 5.1.c (140.000 €): Los datos de redes sociales, navegación web y geolocalización no eran necesarios ni proporcionales para evaluar la solvencia crediticia (principio de minimización).

Este caso es especialmente relevante porque demuestra que la AEPD aplica el artículo 22 del RGPD con rigor: no basta con tener un empleado que «revise» la decisión del algoritmo. La revisión humana debe ser sustantiva, con capacidad real de modificar el resultado [3].

Caso 4: Aseguradora — 540.000 € por discriminación algorítmica

Resolución: PS/00741/2025 Sancionado: Compañía aseguradora Cuantía: 540.000 € Infracción principal: Art. 5.1.a RGPD + Art. 9 RGPD

Una compañía aseguradora utilizaba un algoritmo de IA para valorar siniestros de automóvil. El sistema analizaba múltiples variables para calcular la indemnización, incluyendo el código postal del asegurado, su edad, su historial de reclamaciones y datos meteorológicos del día del siniestro.

Una investigación de oficio de la AEPD detectó que el sistema valoraba sistemáticamente a la baja los siniestros de asegurados residentes en determinados códigos postales, coincidentes con zonas de menor renta per cápita y mayor porcentaje de población inmigrante.

El algoritmo no utilizaba directamente variables como el origen étnico o la renta. Pero el código postal actuaba como proxy de ambas variables, produciendo un efecto discriminatorio indirecto.

La AEPD determinó que:

El tratamiento era desleal (art. 5.1.a) porque producía resultados discriminatorios que el asegurado no podía anticipar ni comprender.

El sistema infería indirectamente datos relativos al origen étnico y la situación económica, lo que constituye un tratamiento de datos de categoría especial sin base legal (art. 9).

No existía mecanismo para que el asegurado impugnara la valoración automatizada del siniestro.

La sanción de 540.000 € se compuso de 340.000 € por vulneración del art. 5.1.a y 200.000 € por vulneración del art. 9 [4].

Caso 5: Empresa de selección de personal — 320.000 € por sesgo en cribado de CV

Resolución: PS/00654/2025 Sancionado: Empresa de consultoría de RRHH Cuantía: 320.000 € Infracción principal: Art. 22 RGPD + Art. 5.1.d RGPD

Una empresa de selección de personal ofrecía a sus clientes corporativos un sistema de cribado automático de currículos basado en inteligencia artificial. El sistema recibía los CV en formato digital, extraía información mediante procesamiento de lenguaje natural (NLP) y puntuaba a los candidatos según su adecuación al puesto.

Tras una reclamación de una candidata que fue descartada en tres procesos consecutivos, la AEPD investigó el sistema y descubrió que el algoritmo:

Penalizaba los «huecos» en el historial laboral sin distinguir entre inactividad voluntaria y permisos de maternidad/paternidad, lo que discriminaba a mujeres.

Infería la edad del candidato a partir de la fecha de titulación y penalizaba a candidatos mayores de 45 años.

Infería la nacionalidad a partir del nombre y los apellidos y mostraba sesgo en contra de nombres de origen no europeo.

No ofrecía información al candidato sobre el uso de IA en la evaluación ni mecanismo para solicitar revisión humana.

La sanción de 320.000 € se distribuyó: 180.000 € por vulneración del art. 22 (decisiones automatizadas sin garantías) y 140.000 € por vulneración del art. 5.1.d (inexactitud, ya que las inferencias del sistema sobre edad, nacionalidad y motivo de inactividad laboral eran frecuentemente incorrectas) [5].

Caso 6: Empresa tecnológica — 275.000 € por monitorización de empleados con IA

Resolución: PS/01023/2025 Sancionado: Empresa del sector tecnológico Cuantía: 275.000 € Infracción principal: Art. 35 RGPD + Art. 5.1.c RGPD

Una empresa de tecnología implantó un sistema de IA para monitorizar la productividad de sus empleados en régimen de teletrabajo. El sistema registraba:

- Pulsaciones de teclado y movimientos de ratón

- Capturas de pantalla periódicas cada 5 minutos

- Uso de aplicaciones y sitios web visitados

- Tiempo de actividad vs. inactividad

- Análisis de sentimiento de correos electrónicos internos

El sistema generaba un «índice de productividad» por empleado que se utilizaba para decisiones de promoción, asignación de proyectos y, en última instancia, despidos.

La AEPD sancionó a la empresa por:

Ausencia de EIPD (150.000 €): La empresa no realizó evaluación de impacto antes de implantar el sistema.

Datos excesivos (125.000 €): La captura de pantalla, el análisis de sentimiento de correos y el registro de pulsaciones de teclado exceden lo necesario para medir la productividad.

Caso 7: Empresa de marketing — 180.000 € por perfilado masivo

Resolución: PS/00987/2025 Sancionado: Agencia de marketing digital Cuantía: 180.000 € Infracción principal: Art. 6 RGPD + Arts. 13-14 RGPD

Una agencia de marketing digital utilizaba un sistema de IA para crear perfiles detallados de consumidores a partir de datos recopilados de múltiples fuentes: cookies, redes sociales, registros de compra, geolocalización y datos de navegación. Estos perfiles se vendían a sus clientes para campañas de publicidad personalizada.

La AEPD determinó que:

- La empresa no tenía base legal válida para la creación de perfiles (ni consentimiento explícito, ni interés legítimo justificado).

- Los interesados no fueron informados del alcance del perfilado ni de las categorías de datos combinados.

- Los perfiles incluían inferencias sobre preferencias políticas, estado de salud y orientación sexual, derivadas de patrones de navegación y consumo.

Caso 8: Clínica privada — 150.000 € por diagnóstico IA sin garantías

Resolución: PS/01102/2025 Sancionado: Grupo hospitalario privado Cuantía: 150.000 € Infracción principal: Art. 9 RGPD + Art. 35 RGPD

Un grupo hospitalario privado implementó un sistema de IA para asistir en el diagnóstico de imágenes radiológicas. El sistema analizaba radiografías y tomografías para detectar posibles patologías y asignaba una probabilidad de diagnóstico.

La AEPD sancionó al grupo por:

- Procesar datos de salud (categoría especial, art. 9) mediante un sistema de IA sin EIPD específica.

- No informar a los pacientes de que un algoritmo participaba en su diagnóstico.

- Transferir las imágenes médicas a un servidor del proveedor de IA ubicado en Estados Unidos sin las garantías adecuadas para transferencias internacionales (arts. 44-49 RGPD).

Lección común de los 8 casos

Todos los casos comparten un denominador común: las empresas desplegaron sistemas de IA sin la preparación regulatoria mínima exigible. No es que la normativa sea nueva o impredecible. Es que fue ignorada. La AEPD ya no tolera esa negligencia.

Sectores de máximo riesgo: análisis en profundidad

Banca y servicios financieros

El sector bancario es el más expuesto a la acción sancionadora de la AEPD por varias razones convergentes:

Volumen de decisiones automatizadas. Los bancos españoles procesan millones de solicitudes de crédito al año. La automatización es inevitable y, en muchos casos, beneficiosa. Pero la escala amplifica los riesgos: un sesgo en el algoritmo de credit scoring no afecta a un cliente sino a miles.

Impacto jurídico directo. La denegación de un crédito hipotecario es, sin duda, una decisión con «efectos jurídicos significativos» en el sentido del artículo 22 del RGPD. Puede determinar si una familia accede a una vivienda o no.

Datos sensibles e inferencias. Los bancos disponen de una cantidad ingente de datos sobre sus clientes: transacciones, patrones de gasto, movimientos de cuenta, historial de productos financieros. Los algoritmos de IA pueden inferir, a partir de estos datos, información sobre salud (compras en farmacias, pagos a seguros médicos), orientación política (donaciones a partidos), vida sexual (pagos en apps de citas) y origen étnico (envíos de remesas a determinados países).

Aplicaciones de IA en banca bajo escrutinio:

- Credit scoring automatizado

- Detección de fraude en transacciones

- Segmentación de clientes para ofertas comerciales

- Chatbots y asistentes virtuales con acceso a datos bancarios

- Análisis de riesgo de morosidad

- Pricing dinámico de productos financieros

- KYC (Know Your Customer) automatizado

- Anti-blanqueo (AML) basado en patrones de transacción

Cada una de estas aplicaciones procesa datos personales, muchas toman decisiones con efectos jurídicos y la mayoría requiere una EIPD específica.

Seguros

El sector asegurador presenta riesgos análogos al bancario, pero con una particularidad adicional: la discriminación algorítmica en seguros tiene un impacto directo en la protección social de las personas.

Aplicaciones de IA en seguros bajo escrutinio:

- Cálculo automático de primas basado en perfilado

- Valoración automatizada de siniestros

- Detección de fraude en reclamaciones

- Underwriting automatizado (aceptación/rechazo de pólizas)

- Análisis predictivo de riesgo

- Telemática y seguros basados en comportamiento (usage-based insurance)

El riesgo principal es la discriminación indirecta. Los algoritmos de seguros pueden utilizar variables aparentemente neutras (código postal, modelo de vehículo, frecuencia de visitas médicas) que actúan como proxies de variables protegidas (origen étnico, nivel económico, estado de salud).

El caso de la aseguradora sancionada con 540.000 € es paradigmático: el sistema no utilizaba la raza del asegurado como variable, pero el código postal correlacionaba tan fuertemente con la composición étnica del barrio que el efecto era equivalente [4].

Recursos humanos y selección de personal

El uso de IA en recursos humanos es probablemente el área donde el impacto en los derechos fundamentales es más directo e inmediato: decidir quién consigue un trabajo y quién no.

Aplicaciones de IA en RRHH bajo escrutinio:

- Cribado automático de currículos (resume screening)

- Análisis de entrevistas en vídeo (expresiones faciales, tono de voz, lenguaje corporal)

- Tests de personalidad automatizados

- Monitorización del rendimiento de empleados

- Predicción de riesgo de dimisión (flight risk)

- Análisis de sentimiento en comunicaciones internas

- Planificación de plantilla basada en predicciones algorítmicas

- Proctoring en procesos de selección (vigilancia remota de pruebas)

El precedente del caso Amazon es instructivo: Amazon tuvo que abandonar su herramienta de IA para selección de personal después de descubrir que el sistema penalizaba currículos que contenían la palabra «mujeres» (como «capitana del equipo de mujeres de ajedrez») y rebajaba puntuaciones de graduadas de universidades exclusivamente femeninas. El sistema había sido entrenado con una década de currículos dominados por hombres y había «aprendido» a preferir perfiles masculinos [19].

En España, la AEPD está prestando especial atención a:

- Sistemas de cribado que infieren edad, género o nacionalidad sin procesarlos directamente

- Análisis de entrevistas por vídeo que procesan datos biométricos (expresiones faciales) sin consentimiento explícito

- Monitorización de empleados que excede lo necesario para la relación laboral

- Sistemas que no informan al candidato de que se utiliza IA en la evaluación

Sanidad

Los sistemas de IA en sanidad procesan datos de categorías especiales (art. 9 RGPD): datos de salud, datos genéticos, datos biométricos. El nivel de exigencia normativa es, por tanto, el máximo.

Aplicaciones de IA en sanidad bajo escrutinio:

- Diagnóstico asistido por IA (radiología, patología, dermatología)

- Triaje automatizado en urgencias

- Predicción de riesgo de enfermedades

- Gestión de historiales clínicos electrónicos

- Monitorización remota de pacientes (IoT médico)

- Investigación clínica y selección de cohortes

- Prescripción asistida de medicamentos

- Robótica quirúrgica asistida por IA

El riesgo no es solo jurídico. Un sesgo en un sistema de diagnóstico puede tener consecuencias letales. Los estudios han demostrado que algunos sistemas de diagnóstico dermatológico por IA funcionan significativamente peor en pieles oscuras, porque fueron entrenados predominantemente con imágenes de pieles claras.

La AEPD y las autoridades sanitarias están coordinando esfuerzos para supervisar el despliegue de IA en hospitales y clínicas. El grupo hospitalario sancionado con 150.000 € por su sistema de diagnóstico radiológico es solo el primer caso de lo que probablemente será una línea de actuación mucho más amplia.

Marketing y publicidad digital

El sector del marketing digital utiliza IA de forma masiva para perfilar consumidores, personalizar publicidad, optimizar campañas y predecir comportamientos de compra. Los riesgos de protección de datos son enormes:

- Perfilado a gran escala sin consentimiento específico

- Combinación de datos de múltiples fuentes (cookies, redes sociales, datos de compra, ubicación) sin transparencia

- Inferencia de datos sensibles (salud, política, orientación sexual) a partir de patrones de navegación y consumo

- Publicidad personalizada basada en vulnerabilidades (personas endeudadas, personas con adicciones, personas en situación emocional vulnerable)

- Targeting de menores o poblaciones vulnerables

Educación

El sector educativo ha adoptado IA especialmente en dos áreas problemáticas:

Proctoring (supervisión de exámenes remotos). Los sistemas de proctoring con IA graban al estudiante mediante cámara y micrófono, analizan sus expresiones faciales, movimientos oculares, movimientos corporales y sonidos ambientales para detectar «comportamientos sospechosos» durante un examen. Estos sistemas procesan datos biométricos sin el consentimiento libre del estudiante (que no puede negarse sin renunciar al examen).

Evaluación automatizada. Sistemas que corrigen trabajos, ensayos y proyectos mediante IA, con impacto directo en las calificaciones académicas de los estudiantes.

El AI Act clasifica ambos usos como alto riesgo (Anexo III, área 3), lo que significa que desde agosto de 2026 estarán sujetos a los diez requisitos obligatorios.

Qué desencadena una investigación de la AEPD

Los cinco orígenes de los 147 expedientes

No todas las investigaciones de la AEPD nacen de una denuncia. Según el informe de actividad supervisora [1], los 147 expedientes se originaron así:

| Origen | Porcentaje | N.º expedientes | Descripción |

|---|---|---|---|

| Reclamaciones ciudadanas | 48 % | ~71 | Personas afectadas por decisiones automatizadas que presentan reclamación formal |

| Investigación de oficio | 27 % | ~40 | Sectores y empresas seleccionados proactivamente por la AEPD para inspección |

| Transferencias de otras autoridades UE | 12 % | ~18 | Coordinación con CNIL, ICO, BfDI y otras autoridades europeas |

| Medios de comunicación | 8 % | ~12 | Investigaciones iniciadas tras publicaciones periodísticas o informes sectoriales |

| Denuncias de empleados | 5 % | ~7 | Canal interno, whistleblowing o denuncias de trabajadores |

Las reclamaciones ciudadanas: el motor principal

El 48 % de los expedientes se origina por reclamaciones de ciudadanos que se sienten afectados por una decisión algorítmica. Los escenarios más frecuentes son:

- Un solicitante de crédito cuya solicitud es denegada sin explicación comprensible

- Un candidato a un puesto de trabajo que sospecha que fue descartado por un algoritmo

- Un asegurado cuya reclamación de siniestro recibe una valoración injustificadamente baja

- Un usuario de un servicio digital que recibe publicidad perturbadoramente personalizada

- Un paciente que descubre que un algoritmo participó en su diagnóstico sin su conocimiento

- Un empleado monitorizado por un sistema de productividad sin su consentimiento informado

El ciudadano no necesita demostrar la infracción. Basta con presentar una reclamación fundamentada ante la AEPD. La Agencia investiga de oficio y, si encuentra indicios, abre expediente.

Las investigaciones de oficio: la AEPD elige sus objetivos

El 27 % de los expedientes procede de investigaciones de oficio. Este porcentaje es significativamente mayor que en otras áreas de actuación de la AEPD, donde las investigaciones de oficio rara vez superan el 10 %.

Esto indica un cambio de estrategia deliberado: la AEPD ha identificado la inteligencia artificial como un área prioritaria y está asignando recursos específicos para inspeccionar proactivamente su uso en sectores clave.

Los criterios que la AEPD utiliza para seleccionar objetivos de investigación de oficio incluyen:

- Sectores con alta penetración de IA y alto impacto en derechos fundamentales

- Empresas que tratan datos a gran escala

- Sistemas de IA conocidos públicamente (por publicidad, notas de prensa, ofertas comerciales)

- Empresas que no responden a las consultas de la AEPD sobre sus tratamientos de datos

- Sectores objeto de informes críticos de organizaciones de consumidores o de la sociedad civil

Las transferencias de otras autoridades UE

El 12 % de los expedientes se origina en transferencias de otras autoridades de protección de datos europeas, principalmente en casos transfronterizos. Cuando una empresa opera en varios países de la UE, la autoridad del país donde tiene su establecimiento principal coordina la investigación, pero puede transferir parte del caso a las autoridades de los países afectados.

Las autoridades más activas en la transferencia de expedientes de IA son la CNIL (Francia), el BfDI (Alemania) y la AP (Países Bajos).

Los medios de comunicación y las denuncias de empleados

El 8 % de los expedientes se inicia tras publicaciones periodísticas sobre el uso de IA por parte de empresas concretas. Los reportajes de investigación sobre algoritmos discriminatorios, monitorización laboral abusiva o tratamiento masivo de datos biométricos han sido detonantes directos de varios expedientes.

El 5 % restante procede de denuncias de empleados, bien a través de canales internos de denuncia (whistleblowing) o directamente ante la AEPD. La Directiva de Protección de Denunciantes (Directiva (UE) 2019/1937) y su transposición española (Ley 2/2023) protegen a los empleados que denuncian infracciones de la normativa de protección de datos.

Un expediente puede llegar por cualquier vía

No existe una forma «segura» de desplegar IA sin controles. Un empleado descontento, un candidato rechazado, un reportaje periodístico o una inspección rutinaria pueden desencadenar un expediente de la AEPD en cualquier momento. La única protección real es el cumplimiento preventivo.

Auditoría algorítmica: metodología del perito informático

Qué es una auditoría algorítmica forense

Una auditoría algorítmica forense es un examen técnico exhaustivo de un sistema de inteligencia artificial realizado por un perito informático con el objetivo de evaluar su cumplimiento normativo, detectar sesgos, verificar la transparencia y documentar su funcionamiento de forma reproducible.

Se diferencia de una auditoría interna o una consultoría de cumplimiento en que el perito aplica metodología forense: preservación de evidencia, cadena de custodia, reproducibilidad de los resultados y elaboración de un informe pericial con valor probatorio ante la AEPD, los tribunales o cualquier organismo regulador.

La auditoría algorítmica es especialmente relevante en dos escenarios:

Preventivo: La empresa quiere verificar que su sistema de IA cumple con el RGPD y está preparado para el AI Act antes de que llegue un expediente.

Reactivo: La AEPD ya ha abierto expediente y la empresa necesita evidencia técnica para sus alegaciones.

Metodología en 10 fases

La auditoría algorítmica forense que realizo como perito informático especializado sigue una metodología estructurada en diez fases:

Fase 1: Inventario y documentación del sistema

Identificación completa del sistema de IA: nombre, versión, proveedor, fecha de despliegue, finalidad, datos de entrada, datos de salida, tipo de modelo (regresión, clasificación, red neuronal, ensemble, modelo generativo, etc.), datos de entrenamiento y arquitectura técnica.

Se verifica la existencia de documentación técnica: especificaciones del modelo, registro de cambios, métricas de rendimiento, informes de validación. La ausencia de documentación técnica es, por sí sola, un hallazgo significativo.

Herramientas: Análisis de repositorios de código, documentación técnica, entrevistas con el equipo de desarrollo, revisión de contratos con proveedores.

Fase 2: Mapeo del flujo de datos

Cartografía completa del recorrido de los datos personales desde su recogida hasta la decisión final del algoritmo. Incluye:

- Origen de los datos (formularios, APIs, scraping, compra a terceros, inferencia)

- Transformaciones aplicadas (normalización, codificación, imputación de valores ausentes, creación de variables derivadas)

- Almacenamiento (ubicación geográfica de los servidores, cifrado, controles de acceso)

- Flujos de datos a terceros (proveedores de IA, servicios cloud, subencargados)

- Retención y eliminación (plazos de conservación, procedimientos de borrado)

Herramientas: Diagramas de flujo de datos (DFD), análisis de logs de acceso, revisión de configuración de bases de datos y APIs.

Fase 3: Revisión de la EIPD

Evaluación crítica de la Evaluación de Impacto en Protección de Datos (EIPD) existente, verificando:

- ¿Se realizó antes del despliegue del sistema?

- ¿Cubre específicamente el sistema de IA y no es una EIPD genérica?

- ¿Identifica correctamente los riesgos para los derechos de los interesados?

- ¿Evalúa la necesidad y proporcionalidad del tratamiento?

- ¿Considera alternativas menos intrusivas?

- ¿Propone medidas de mitigación adecuadas?

- ¿Se ha consultado al DPD?

- ¿Se ha actualizado tras cambios en el sistema?

Si no existe EIPD, este hallazgo se documenta como una no conformidad crítica. Si existe pero es insuficiente (como en el caso de Aena), se detalla cada deficiencia.

Herramientas: Análisis documental, comparación con las directrices del Grupo de Trabajo del Art. 29 (WP248) y las guías de la AEPD.

Fase 4: Análisis de base legal

Verificación de que cada tratamiento de datos personales realizado por el sistema de IA tiene una base legal válida (art. 6 RGPD):

- Consentimiento: ¿Es libre, específico, informado e inequívoco? ¿Puede revocarse?

- Ejecución de contrato: ¿El tratamiento es estrictamente necesario para el contrato?

- Interés legítimo: ¿Se ha realizado el test de ponderación? ¿El interés del responsable prevalece sobre los derechos del interesado?

- Obligación legal: ¿Existe una norma que obligue al tratamiento?

Para datos de categorías especiales (art. 9), se verifica que concurre una de las excepciones: consentimiento explícito, obligación laboral, interés vital, interés público esencial, etc.

Herramientas: Revisión de políticas de privacidad, formularios de consentimiento, contratos con interesados, evaluaciones de interés legítimo.

Fase 5: Test de sesgo y discriminación

Esta es una de las fases más técnicas y más relevantes de la auditoría. Consiste en evaluar si el sistema de IA produce resultados discriminatorios para determinados grupos de personas.

Métricas de equidad analizadas:

Métrica Qué mide Umbral de alerta Disparate Impact Ratio entre la tasa de resultados positivos del grupo privilegiado y la del grupo desaventajado < 0,8 (regla del 80 %) Equal Opportunity Difference Diferencia en la tasa de verdaderos positivos entre grupos > 0,1 Demographic Parity Difference Diferencia en la tasa de resultados positivos entre grupos > 0,1 Predictive Equality Diferencia en la tasa de falsos positivos entre grupos > 0,1 Calibration ¿Las probabilidades predichas son igualmente precisas para todos los grupos? Diferencia > 0,05 Counterfactual Fairness ¿Cambiaría la decisión si la variable protegida fuera diferente? Cualquier cambio Se analizan estas métricas segmentadas por variables protegidas: género, edad, nacionalidad o etnia (inferida), código postal como proxy de renta y etnia, discapacidad (si es inferible), estado familiar.

Herramientas: IBM AI Fairness 360, Fairlearn (Microsoft), Aequitas, análisis estadístico personalizado con Python (pandas, scikit-learn).

Fase 6: Test de explicabilidad e interpretabilidad

Evaluación de si las decisiones del sistema de IA pueden ser comprendidas y explicadas a los interesados de forma significativa.

Se aplican técnicas de IA explicable (XAI):

- SHAP (SHapley Additive exPlanations): Determina la contribución de cada variable a la decisión individual.

- LIME (Local Interpretable Model-agnostic Explanations): Genera explicaciones locales comprensibles para decisiones individuales.

- Feature importance: Análisis de la importancia relativa de cada variable en el modelo global.

- Counterfactual explanations: Generación de explicaciones del tipo «la decisión habría sido diferente si…».

- Decision trees proxy: Creación de modelos interpretables que aproximan el comportamiento del modelo complejo.

El objetivo es determinar si la empresa puede cumplir con los artículos 13-14 del RGPD (derecho a información significativa sobre la lógica del tratamiento) y el artículo 22 (derecho a explicación de la decisión automatizada).

Herramientas: SHAP, LIME, ELI5, InterpretML, Captum (PyTorch), análisis personalizado.

Fase 7: Evaluación de la supervisión humana

Verificación de si existe supervisión humana efectiva — no meramente nominal — de las decisiones del sistema de IA.

Se evalúan tres niveles de supervisión:

- Human-in-the-loop (HITL): Un humano toma la decisión final en cada caso, utilizando la salida del sistema de IA como insumo.

- Human-on-the-loop (HOTL): Un humano supervisa el sistema en tiempo real y puede intervenir cuando detecta anomalías.

- Human-in-command (HIC): Un humano tiene la capacidad de detener completamente el sistema en cualquier momento.

Para cada nivel, se verifica:

- ¿El operador humano tiene formación adecuada?

- ¿Dispone de tiempo suficiente para revisar cada caso?

- ¿Tiene acceso a la información necesaria para tomar una decisión informada?

- ¿Tiene autoridad real para modificar o revertir la decisión del algoritmo?

- ¿Existe un registro de las intervenciones humanas?

- ¿Qué porcentaje de las decisiones del algoritmo son efectivamente modificadas por el operador?

Si el operador humano valida más del 95 % de las decisiones del algoritmo sin modificarlas, existe un riesgo significativo de que la supervisión sea meramente nominal (automation bias).

Fase 8: Análisis de los datos de entrenamiento

Evaluación de la calidad, representatividad y licitud de los datos utilizados para entrenar el modelo de IA:

- ¿Los datos de entrenamiento se obtuvieron legalmente?

- ¿Contienen datos personales? ¿Se obtuvo consentimiento para su uso en entrenamiento de IA?

- ¿Los datos son representativos de la población sobre la que se aplicará el modelo?

- ¿Existen sesgos históricos en los datos (por ejemplo, datos de contratación que reflejan discriminación pasada)?

- ¿Se han aplicado técnicas de mitigación de sesgos en los datos (resampling, reweighting, aumento de datos)?

- ¿Los datos están actualizados o son obsoletos?

Fase 9: Análisis de seguridad y robustez

Evaluación de la seguridad del sistema de IA frente a ataques adversarios y manipulación:

- Ataques adversarios: ¿Es el modelo vulnerable a perturbaciones mínimas en los datos de entrada que alteren drásticamente la decisión?

- Envenenamiento de datos (data poisoning): ¿Existen controles para detectar manipulación de los datos de entrenamiento?

- Extracción del modelo (model extraction): ¿Existen protecciones contra la copia no autorizada del modelo?

- Inferencia de datos (membership inference): ¿Puede un atacante determinar si un dato concreto se utilizó en el entrenamiento?

- Integridad de la cadena de suministro: ¿Los componentes de terceros (librerías, frameworks, APIs) son seguros y están actualizados?

Fase 10: Informe pericial y recomendaciones

Elaboración del informe pericial técnico que documenta todos los hallazgos de la auditoría:

- Resumen ejecutivo para la dirección

- Descripción técnica del sistema auditado

- Metodología de la auditoría

- Hallazgos clasificados por gravedad (crítico, alto, medio, bajo)

- Evidencia documental con hash de integridad

- Análisis de conformidad con RGPD y AI Act

- Recomendaciones priorizadas de remediación

- Anexos técnicos (datos estadísticos, capturas, configuraciones)

El informe sigue la estructura exigida para informes periciales judiciales (arts. 335-352 LEC) y es apto para su presentación ante la AEPD, tribunales o la AESIA.

Herramientas técnicas utilizadas en la auditoría

| Herramienta | Propósito | Tipo |

|---|---|---|

| IBM AI Fairness 360 | Detección y mitigación de sesgos | Open source |

| Fairlearn (Microsoft) | Métricas de equidad y mitigación | Open source |

| SHAP | Explicabilidad de modelos (Shapley values) | Open source |

| LIME | Explicaciones locales interpretables | Open source |

| Aequitas | Auditoría de sesgo y equidad | Open source |

| InterpretML | Suite de interpretabilidad | Open source |

| What-If Tool (Google) | Exploración visual de modelos | Open source |

| Adversarial Robustness Toolbox (IBM) | Test de robustez y ataques adversarios | Open source |

| Great Expectations | Validación de calidad de datos | Open source |

| DVC (Data Version Control) | Trazabilidad de datos y modelos | Open source |

| MLflow | Registro de experimentos y modelos | Open source |

| Herramientas forenses propias | Captura forense, hash, cadena de custodia | Propiedad |

Diferencia clave: auditoría forense vs. consultoría

Una auditoría algorítmica realizada por un perito informático tiene valor probatorio ante la AEPD, los tribunales y los organismos reguladores. Una consultoría de cumplimiento, no. Si tu empresa se enfrenta a un expediente sancionador, necesitas un informe pericial, no un informe de consultoría.

Cómo preparar la defensa ante la AEPD

El procedimiento sancionador: plazos y fases

Cuando la AEPD abre un expediente sancionador, el procedimiento sigue estas fases:

Actuaciones previas de investigación

La AEPD recopila información antes de decidir si abre expediente formal. Puede solicitar información a la empresa, inspeccionar sistemas, entrevistar a responsables o analizar documentación técnica.

Duración: Variable (1-12 meses).

Acción recomendada: Cooperar plenamente. La obstrucción es una infracción adicional.

Acuerdo de inicio del procedimiento sancionador

Si la AEPD considera que existen indicios suficientes, emite un acuerdo de inicio que identifica al responsable, los hechos investigados, la calificación jurídica provisional y la sanción propuesta.

Duración: Notificación inmediata.

Acción recomendada: Este es el momento crítico. Contactar inmediatamente con un abogado especializado y un perito informático.

Plazo de alegaciones al acuerdo de inicio

La empresa tiene 15 días hábiles (ampliables a 30 en caso de complejidad) para presentar alegaciones al acuerdo de inicio.

Acción recomendada: Preparar alegaciones técnico-jurídicas. El informe pericial debe elaborarse y presentarse en este plazo.

Propuesta de resolución

Tras analizar las alegaciones, el instructor emite una propuesta de resolución que puede confirmar, modificar o retirar los cargos.

Duración: 1-3 meses tras las alegaciones.

Acción recomendada: Nuevas alegaciones si la propuesta difiere del acuerdo de inicio.

Plazo de alegaciones a la propuesta

La empresa tiene 15 días hábiles adicionales para alegar contra la propuesta de resolución.

Acción recomendada: Aportar evidencia adicional si se han implementado medidas correctoras desde el inicio del expediente.

Resolución final

La directora de la AEPD emite la resolución final, que puede imponer la sanción propuesta, reducirla, incrementarla o archivar el expediente.

Acción recomendada: Evaluar la posibilidad de recurso contencioso-administrativo si la resolución es desfavorable. Plazo: 2 meses.

Estrategia de defensa con apoyo pericial

La defensa ante un expediente de la AEPD por uso de IA requiere una estrategia que combine argumentos jurídicos y evidencia técnica. En mi experiencia como perito en estos procedimientos, los elementos clave son:

1. Demostrar responsabilidad proactiva.

El artículo 5.2 del RGPD exige que el responsable pueda demostrar que cumple. Si la empresa puede aportar documentación que acredite que evaluó los riesgos, implementó medidas y supervisó el sistema antes de que la AEPD abriera expediente, la posición de defensa mejora sustancialmente.

Documentos clave:

- EIPD específica para el sistema de IA

- Registro de actividades de tratamiento que incluya el sistema de IA

- Actas de reuniones del DPD sobre el sistema de IA

- Informes internos de auditoría

- Registros de formación al personal

- Políticas de uso de IA aprobadas por la dirección

2. Aportar evidencia técnica de cumplimiento.

El informe pericial debe responder punto por punto a los hechos del expediente. Si la AEPD alega discriminación algorítmica, el informe debe demostrar —con datos estadísticos reproducibles— que el sistema no discrimina. Si alega falta de supervisión humana, el informe debe documentar el proceso de supervisión con registros, métricas y evidencia de intervenciones reales.

3. Demostrar medidas correctoras.

La AEPD valora significativamente la adopción de medidas correctoras durante el procedimiento. Si la empresa puede demostrar que, tras el inicio del expediente, ha:

- Realizado una EIPD completa

- Implementado supervisión humana efectiva

- Ejecutado tests de sesgo y corregido los hallazgos

- Mejorado la información al interesado

- Formado al personal

…la sanción puede reducirse entre un 20 % y un 80 % según la gravedad del caso y la efectividad de las medidas.

4. Cuestionar la calificación jurídica.

En algunos casos, la AEPD puede calificar la infracción incorrectamente. Por ejemplo, puede calificar como «decisión automatizada» (art. 22) un sistema que realmente cuenta con supervisión humana efectiva. El informe pericial puede demostrar que la calificación técnica no se corresponde con la realidad del sistema.

5. Alegar proporcionalidad de la sanción.

Si la infracción se confirma, la defensa puede argumentar que la sanción propuesta es desproporcionada, aportando comparativas con sanciones impuestas en casos similares y evidencia de la capacidad económica de la empresa.

Caso práctico: reducción del 70 % de una sanción mediante auditoría algorítmica

En un expediente reciente, una empresa tecnológica se enfrentaba a una sanción propuesta de 600.000 € por utilizar un sistema de IA que analizaba el comportamiento de sus empleados para predecir su rendimiento y probabilidad de dimisión.

El sistema recopilaba datos de:

- Correos electrónicos (volumen, horarios, tiempo de respuesta)

- Actividad en herramientas internas (Slack, Jira, Confluence)

- Horarios de conexión y desconexión

- Participación en reuniones virtuales

Tras la auditoría algorítmica, mi informe pericial demostró que:

El 40 % de los datos procesados eran innecesarios para la finalidad declarada (predicción de rendimiento). El contenido de los correos electrónicos y las conversaciones de Slack no contribuían significativamente al modelo y constituían una violación del principio de minimización.

Existía supervisión humana real en las decisiones de gestión. Los managers recibían la puntuación del algoritmo como un insumo más, pero tomaban las decisiones de promoción y asignación de proyectos de forma autónoma, modificando la recomendación del sistema en un 34 % de los casos.

La empresa implementó medidas correctoras significativas antes de la resolución: eliminó los datos de contenido de comunicaciones del modelo, realizó una EIPD completa, estableció un protocolo de información a los empleados y nombró a un supervisor humano con autoridad real.

La sanción final se redujo a 180.000 € — un 70 % menos que la propuesta inicial. La clave fue aportar evidencia técnica rigurosa durante el plazo de alegaciones [9].

Tabla: acciones preventivas priorizadas

| Acción | Prioridad | Plazo | Coste estimado | Impacto en defensa |

|---|---|---|---|---|

| Inventario de sistemas de IA | Crítica | Inmediato | Bajo | Demuestra conocimiento y control |

| EIPD para cada sistema | Crítica | 30 días | Medio | Elimina la infracción más frecuente |

| Revisión de bases legales | Alta | 30 días | Medio | Asegura legitimidad del tratamiento |

| Test de sesgo algorítmico | Alta | 60 días | Medio-Alto | Detecta discriminación antes que la AEPD |

| Supervisión humana real | Alta | 60 días | Medio | Cumple art. 22 y AI Act art. 14 |

| Información al interesado | Alta | 30 días | Bajo | Cumple arts. 13-14 RGPD |

| Formación al personal | Media | 90 días | Bajo | Cumple art. 4 AI Act (ya obligatorio) |

| Logging y trazabilidad | Media | 90 días | Medio | Cumple AI Act art. 12 |

| Auditoría externa | Recomendada | Antes ago. 2026 | Alto | Evidencia de responsabilidad proactiva |

| Protocolo de impugnación | Alta | 60 días | Bajo | Cumple art. 22.3 RGPD |

Principio fundamental

La AEPD valora significativamente la responsabilidad proactiva (art. 5.2 RGPD). Una empresa que demuestra que evaluó los riesgos, implementó medidas y documentó todo el proceso tiene muchas más probabilidades de recibir un apercibimiento en lugar de una multa — o una multa sustancialmente inferior.

El AI Act: cuenta atrás hacia agosto de 2026

Lo que ya es obligatorio (desde febrero y agosto 2025)

Muchas empresas creen que el AI Act es una norma «futura». No lo es. Varias obligaciones ya están en vigor:

Desde el 2 de febrero de 2025: